Aiutare tutti a stare meglio: è la salute al tempo dell’AI

Aiutare tutti a stare meglio: è la salute al tempo dell’AI

Una utile guida dell’Organizzazione Mondiale della Sanità mostra come l’Intelligenza Artificiale favorisca cure più efficaci e più disponibili

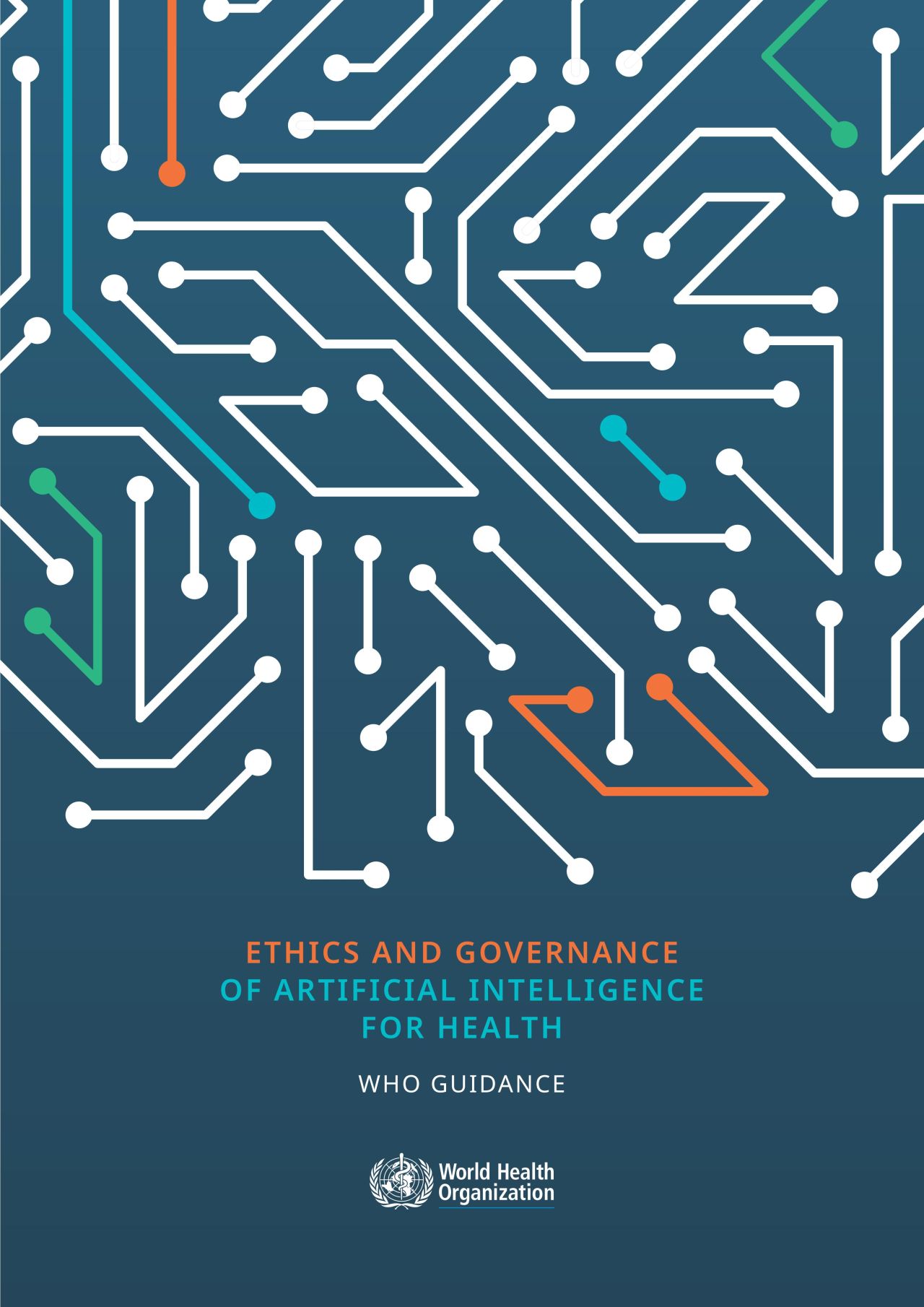

Alla fine di giugno dell’anno scorso, l’Organizzazione Mondiale della Sanità ha presentato un corposo testo dal titolo “Ethics and Governance of Artificial Intelligence for Health”. Forse perché distratti da temi più estivi o poco attratti dalle dimensioni dello studio, questo documento non è stato molto commentato, anzi.

Eppure, tutti siamo interessati alla nostra salute, all’evoluzione della medicina, alla possibilità di liberarci da una serie di tormenti che possono molestarci, soprattutto quando l’età avanza.

Niente da fare.

Probabilmente “Ethics” è ancora un termine che a molti evoca qualcosa che sta lì, sulle nuvole, in un mondo parallelo e irreale che poco o niente ha in comune con la vita di ogni giorno, ancor meno con il progresso della tecnica.

Etica non è una parola che usiamo quotidianamente, sebbene sia correlata con l’origine di ogni lamentela rivolta a chi ha potere, a chi decide su qualsiasi scala, dal primo ministro al capufficio, indiscriminatamente tutti accusati di non agire per il bene comune, di favorire gli interessi propri o quelli del clan di appartenenza. Più in generale, si declama la “perdita dei valori”, la sempre più bassa qualità morale dei giovani, la maleducazione incipiente, le colpe di Internet (più o meno le stesse che ieri si attribuivano alla “cattiva maestra televisione”), l’inevitabile declino di una società umana destinata ad autodistruggersi o a finire schiava dei robot.

Insomma, senza essere chiamata per nome, l’etica sembra a molti ciò che, sparendo, apre la strada al cupio dissolvi dell’umanità. E amen. Messa finita, andate in pace, dimentichi di ciò che è indispensabile per risolvere i problemi: occuparsene.

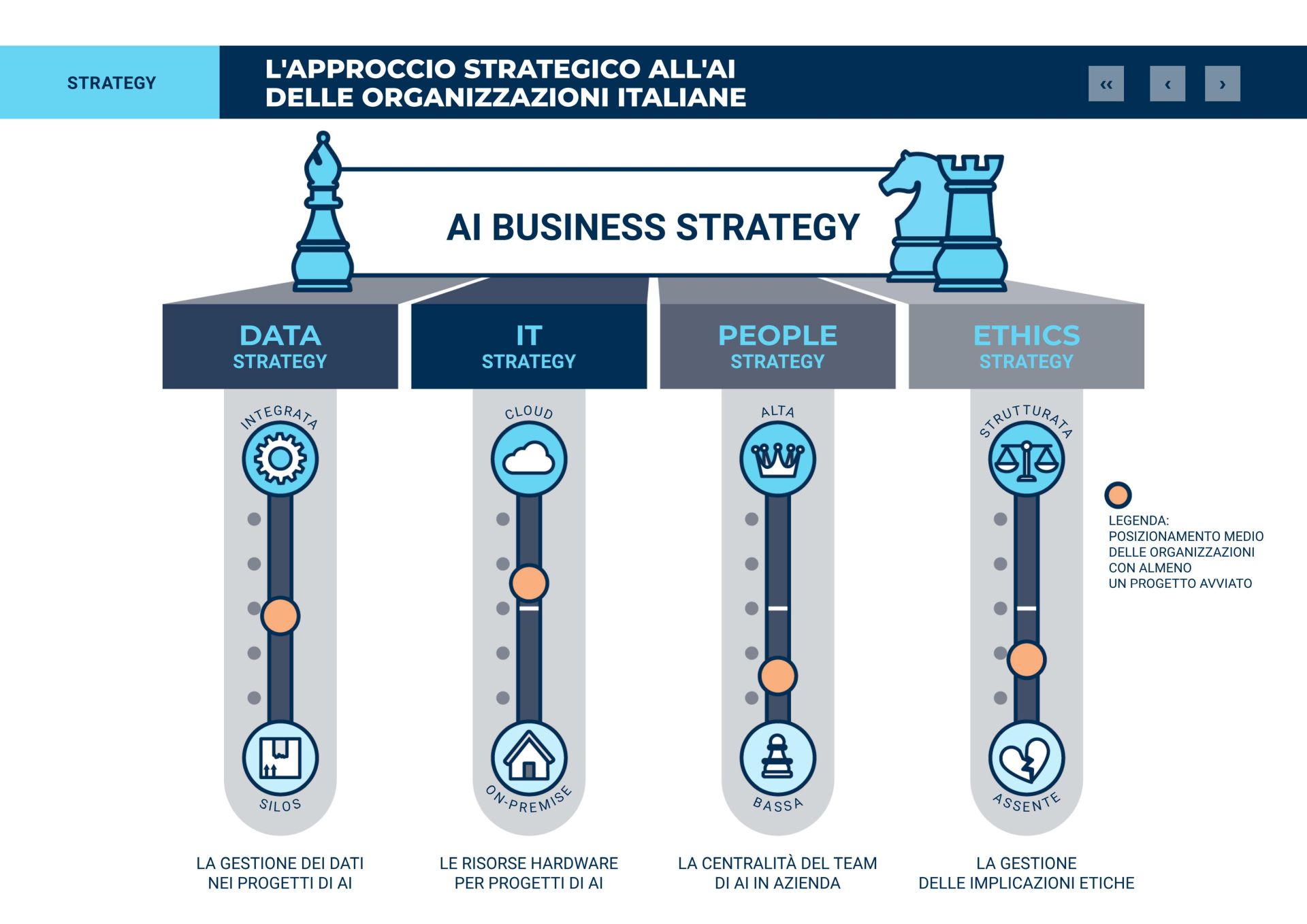

Così non stupisce che il 3 febbraio, durante l’appuntamento di riferimento per tutto il mondo economico italiano in cui l’Osservatorio Artificial Intelligence del Politecnico di Milano presenta i risultati dei propri studi, in una delle slide si evidenzi proprio come la gestione delle implicazioni etiche sia poco considerata nell’approccio delle aziende all’applicazione dell’AI.

In una visione ancora distorta dalla novità del fenomeno, la percezione che raccogliere ed esaminare dati attraverso cui costruire digitalmente nuova conoscenza sia un processo capace di avere diretti effetti sulla vita delle persone non è ancora cresciuta quanto serve a porre in adeguato risalto i pericoli reali di produrre risultati nocivi e persino disastrosi.

Predire le conseguenze crea progetti di successo

L’ideazione di un progetto scaturisce da un obiettivo futuro, dalla ricerca di conseguenze positive dell’agire prossimo. È stato detto che il nostro cervello è immaginabile come un costante previsore del dopo, che sia vicino o remoto: mezzi ed esperienza sono costantemente visualizzati dalla mente per predire quel che si pensa possa accadere, meglio se influenzabile dalla volontà.

Questo esercizio continuo sembra riuscire tanto meglio quanto eventi e cose siano direttamente legati, facilmente connettibili nell’atto e nel pensiero: fame, panino, nutrimento. Tutto si complica nella distanza tra oggetto e soggetto: come pensare che interpretare numeri e perfino semplicemente raccoglierli possa provocare danni, ferire persone, far chiudere aziende?

Il documento della WHO, con lessico formale e ordinato, lo fa capire chiaramente.

Sin dalla prima pagina i possibili progressi che l’AI può portare nella prevenzione e cura delle malattie sono messi a confronto con la necessità che il suo utilizzo non confligga con altri diritti della persona, diversi da quello alla salute.

Una riflessione significativa è quella in merito all’importanza che l’impatto dell’AI in campo sanitario può avere anche per i Paesi più poveri. È una importante considerazione che sembra in controtendenza, giacché spesso si indica nella quantità di denaro che ogni Nazione investe su questa nuova metodologia l’indicatore del futuro benessere dei suoi cittadini, come se l’AI fosse strumento restringibile all’uso di pochi e non attività di ricerca scientifica e, come tale, distribuibile in ogni dove. Inoltre, l’uso del cloud e la conseguente disponibilità di capacità di calcolo anche per utenti che vivono in Paesi poveri permette di pensare che l’AI e i suoi risultati saranno più facilmente a loro disponibili di quanto lo siano, ad esempio, i farmaci, la cui logistica è e resta uno dei maggiori problemi per ottenere una omologa capacità di cura in ogni area della Terra.

Valter Fraccaro: “L’AI senza etica non è vera intelligenza”

Affidare la salute a enti responsabili e specializzati

La necessità di un regolamentazione internazionale della possibilità per le grandi compagnie del Web di raccogliere dati sulla salute delle persone non viene poi giustificata dal solo possibile sfruttamento economico di queste informazioni ma, con più profonda avvedutezza, anche con la possibilità che questo dia modo ad organizzazioni che non seguono alcuna regola di farsi fornitrici di cure, senza dover in alcun modo rispondere degli esiti della loro attività.

Aziende siffatte, agendo al di fuori di ogni controllo e normativa, potrebbero facilmente approfittare di ciò utilizzando l’AI senza un adeguato “filtro” umano, cioè lasciando che le decisioni ora prese da medici e pazienti siano trasferite integralmente alle macchine. Questo trasferimento incondizionato di potere è uno dei punti su cui l’umanità intera deve porre la massima attenzione nell’uso dell’Intelligenza Artificiale, non solo a riguardo della salute. Il rischio è quello di lasciar fare, di nascondere la responsabilità umana dietro alla fragile cortina dell’automatismo digitale, di fare dei computer un comodo alleato capace di prendere decisioni che la coscienza impedirebbe ma che assicurerebbero a qualcuno un possibile vantaggio a scapito di altri. I “valori” che tanto si ama affermare quando non mettono a repentaglio egoistici benefici sarebbero così sacrificati senza alcun sentimento di colpa, tanto “è stata la macchina”.

L’”autonomia umana”, come la si chiama nel testo WHO, non è mai minacciata dalle capacità dei computer se l’ultima decisione sta ad una persona. Proprio qui, consci della fragilità umana, nasce il quesito dirimente: come genere umano, sapremo resistere alla tentazione di non prenderci carico di pesanti responsabilità quando potremo comodamente lasciarle al computer stesso?

È per fornire elementi per rispondere a questa domanda che i lavori condotti per due anni dall’ampia commissione che ha prodotto “Ethics and Governance of Artificial Intelligence for Health” si concentrano su sei “core principles”, simili a quelli che si riscontrano in altri atti simili prodotti, ad esempio, dalla Commissione Europea. Lungi dal giudicare questa somiglianza come difetto, ritengo si debba invece essere soddisfatti ogni qualvolta si percepisca un comune sentire tra esperti che vivono e rappresentano culture differenti, che si occupano di applicazione delle tecnologie in ambiti lontani tra loro.

La Bossa Nova come l’AI esito di un ingegno antico e diffuso

Trasparenza, condivisione, bene comune in sei principi

“Protect autonomy” è il primo di questi sei principi e nell’intento della WHO esso deve riflettersi in particolare sul modo in cui le applicazioni di AI vengono prodotte, facendo sì che esse siano implicitamente “progettate per assistere gli umani” nelle loro attività di assistenza sanitaria. Esse devono quindi basarsi e inglobare “i valori umani e le considerazioni morali”, non essere indipendenti da questi fattori o, peggio, obbedire ad una qualche oggettività.

Non è un principio di semplice applicazione. Come ogni medico, anche chi elabora le soluzioni di AI ha un proprio sistema di valori, definito dal contesto culturale in cui è cresciuto e dalle sue convinzioni personali e poiché ogni legislatore è sottoposto anch’esso allo stesso genere di influenza, addivenire a regolamentazioni internazionali richiede un consenso che probabilmente si troverà solo su definizioni inclusive perché molto generali.

È sempre in questo contesto che l’OMS ribadisce come sia indispensabile che i processi di AI e le leggi che mirano a normarli facilitino l’accesso della singola persona ai propri dati e alla loro gestione.

Il secondo principio riguarda la necessità che l’Intelligenza Artificiale sia utilizzata al fine di promuovere il benessere umano, la sicurezza della persona e il pubblico interesse.

Esistono casi in cui non è facile tenere insieme questi tre diversi obiettivi, come si è ben compreso attraverso la lotta al terrorismo, in cui si è dovuto trovare un bilanciamento tra la gestione della riservatezza delle informazioni personali e la necessità di conoscerle per evitare danni alla comunità.

Innanzitutto, la WHO sottolinea in materia di salute come l’uso dell’AI non debba creare danni alle persone e insiste sulla necessità che ogni processo digitale creato sia valutato e approvato prima di essere messo in funzione e che i risultati di esso debbano essere costantemente monitorati da chi finanzia, realizza e utilizza tali strumenti. In questo, l’AI è trattato allo stesso modo delle tecnologie di ricerca, sviluppo e produzione dei farmaci o come la definizione di nuovi protocolli di cura.

Ci si sofferma poi su un tema etico davvero drammatico, cioè come si debba maneggiare con delicatezza l’esito AI che diagnostichi una possibile patologia che il paziente non può affrontare per indisponibilità di una cura o di adeguati mezzi economici o sanitari, cosa che può oltretutto portare ad un isolamento sociale della persona affetta. Il testo della WHO non dice “come” si debba procedere in queste circostanze ed è giusto così, visto che ogni caso di questo genere non può che essere affrontato singolarmente, dato il numero dei fattori che lo condizionano.

E l’Italia dà il la al piano per l’intelligenza artificiale

Trattare l’AI nello stessa maniera della ricerca medica

Un tema apparentemente più tecnico è affrontato nel terzo dei sei principi, cioè l’intellegibilità del comportamento AI attraverso la sua trasparenza e spiegabilità. Si intende cioè che qualsiasi algoritmo utilizzato sia comprensibile leggendone il codice (attività ovviamente possibile solo per coloro che hanno competenze di scrittura e sviluppo del software), come pure che esso possa essere spiegato ad una persona di diverso livello culturale in modo che le riesca comunque comprensibile. Questo secondo aspetto è determinante perché il soggetto che opera sulla base del suggerimento della macchina (il medico, ad esempio) o, tanto più, ne deve subire le conseguenze (il paziente, soprattutto) possa decidere in maniera informata.

Anche qui, le indicazioni non sono dissimili da quelle previste per i protocolli di cura, in particolare per quelli sperimentali.

Si vuole così eliminare il pericolo di “black box”, cioè di processi digitali che si svolgano senza rendere possibile il controllo umano della loro elaborazione. È una notevole rappresentazione di coerenza del gruppo di lavoro che ha lavorato a queste risoluzioni, eppure dal punto di vista etico la questione è tutt’altro che risolvibile in via generale: ad esempio, se una “black box” genera una risposta di cui non si riesce a conoscere compiutamente l’origine, ma che si rivela risolutiva per guarire una certa malattia, che cosa si fa? Che cosa si farà prevalere? L’effetto del risultato conseguito o la mancata trasparenza del sistema, bloccando l’utilizzo di quanto scoperto?

Come in molte altre occasioni, si scopre che anche qui una regola generale è appropriata, ma non sufficiente per affrontare con sicurezza ogni possibile eventualità.

Rete svizzera di competenze per l’intelligenza artificiale

Valutare, correggere, migliorare come metodo

“Foster responsability and accountability” è l’indicazione del quarto punto su cui si concentra il testo dell’Organizzazione Mondiale della Sanità e lo fa in maniera encomiabile, evitando in ogni modo di responsabilizzare il “digitale” per spostare su di esso quanto invece attiene alle persone. Secondo questo passo del documento, non solo si deve prevedere un sistema di risarcimento per chi dovesse subire danni da una decisione umana derivata da informazioni fornite da soluzioni AI, ma si indicano due comportamenti molto precisi: innanzitutto, che sia verificato il funzionamento della soluzione stessa e risolto in modo da ridurre il rischio che l’episodio possa ripetersi; secondariamente, che la responsabilità ricada sull’intero team che ha gestito sia l’applicazione che la scelta attuativa, per eliminare così il rischio che un qualsiasi scaricabarile porti, di fatto, a determinare una generale estraneità umana al danno causato.

Gli stessi autori sottolineano come l’applicazione di questo concetto non sia di semplice attuazione nei dispositivi legali dei singoli Paesi, legati a modelli giuridici differenti, ma proprio per questo richiamare l’attenzione sulla questione è operazione meritevole.

Come sesta ed ultima raccomandazione, il testo della WHO suggerisce di fare in modo che ogni soluzione AI per la sanità sia realizzata in modo da potersi adattare rapidamente a nuove situazioni e poter essere migliorata costantemente in base ai risultati conseguiti dalla sua applicazione. Ancora una volta, questo messaggio viene rivolto in maniera estesa, includendo designer, sviluppatori e fruitori, a rimarcare come l’AI debba essere considerata sempre una metodologia inclusiva e sociale, non da lasciare in mano a poche persone, ognuna delle quali responsabile solo di una parte della sua creazione o utilizzo. Questo fil rouge lega insieme ogni passaggio del documento: etica, ideazione e uso sono viste come integrate tra di loro e sfociano nella ricerca della sostenibilità, che altro non è se non il frutto di un lavoro comune al perfezionamento continuo.

In questa sintesi si perdono certo mille riflessi e angolature che il comitato creato dalla WHO approfondisce nelle oltre 160 pagine e che meriterebbero ulteriore trattazione. La strada indicata per la salute al tempo dell’AI è comunque chiara: partendo da un metodo, decidendo di condizionarlo con scelte etiche, applicandolo con uno spirito che mette al centro la persona come esito e come responsabile dell’esito stesso, l’Intelligenza Artificiale porta distante quanto la nostra mente può spingersi restando umana e senza trasformarsi da realizzatrice di sogni in fabbrica di incubi.

Un forum di qualità per intelligenza artificiale e imprese

Potresti essere interessato anche a:

Stati Uniti: Grana Padano protagonista della ristorazione

Il Consorzio di Tutela vola a San Antonio per la prima tappa di una campagna che sensibilizza i consumatori sul tema dell’Italian Sounding

Deep Sea Mining, la corsa all’oro che minaccia le balene

L'allarme degli scienziati: se l’ISA darà il via libera all’estrazione di minerali sui fondali marini ci saranno conseguenze catastrofiche...

Tutta l’innovazione dell’approdo del Gruppo Chery in Europa

Il 4 luglio i brand cinesi Omoda e Jaecoo hanno fatto il loro debutto a Milano e sul nostro mercato con auto sostenibili e al passo dei tempi

Le sostanze chimiche degli pneumatici finiscono nel nostro cibo

Uno studio austriaco dimostra che gli additivi sprigionati dall’usura delle gomme su strada finiscono nelle verdure in vendita al supermercato